プログデンスの取り組み

AI資産を自社で持つ!DGX SparkによるローカルLLM検証

はじめに:生成AI導入の「壁」を、自社保有のパワーで突破する

昨今の生成AIブームにより、多くの企業がLLM(大規模言語モデル)の導入を模索しています。

しかし、実用化にあたっては以下の3つの壁に直面するケースが少なくありません。

- 機密情報の取り扱い(セキュリティリスク)

- 不透明なランニングコスト(従量課金)

- データ処理スピードとレスポンスの限界

株式会社プログデンスでは、これらの課題を解決する最適解として、NVIDIAの最新AIコンピューティング基盤「NVIDIA DGX Spark」を導入。自社環境でLLMを運用する「ローカルLLM」の可能性について、実証実験(PoC)を開始しました。

なぜ今、あえて「ローカルLLM」?

パブリックなクラウドAPIを利用せず、自社基盤(オンプレミス/ローカル)でLLMを動かすことには、ビジネス上の明確なアドバンテージがあります。

- 究極のデータガバナンス

社外秘ドキュメントや個人情報を外部サーバーへ送信せず、完全にクローズドな環境で学習・推論が可能です。

- ドメイン特化型のカスタマイズ

業界用語や社内独自のルールを反映させた「自社専用モデル」を、納得いくまで微調整(ファインチューニング)できます。

- 中長期的な経済合理性

大規模かつ高頻度な推論を行う場合、従量課金のAPI利用に比べ、自社基盤の方がトータルコストを抑えられる可能性があります。

コンパクトながら「暴力的」な演算性能:NVIDIA DGX Spark

今回の検証の核となるNVIDIA DGX Sparkは、AI開発のために設計された専用のモンスターマシンです。

驚異的なパワーとサイズの両立

スマートフォンと並べても遜色のないコンパクトな筐体でありながら、その中身はAI専用GPUによる圧倒的な並列計算能力を秘めています。通常、数日を要するモデルの学習や検証を数時間〜数分にまで短縮。この「計算の圧倒的加速」が、ビジネスのアジリティ(敏捷性)を支えます。

検証プロジェクトのロードマップ

本プロジェクトでは、実用性を重視した2つのフェーズで検証を進めています。

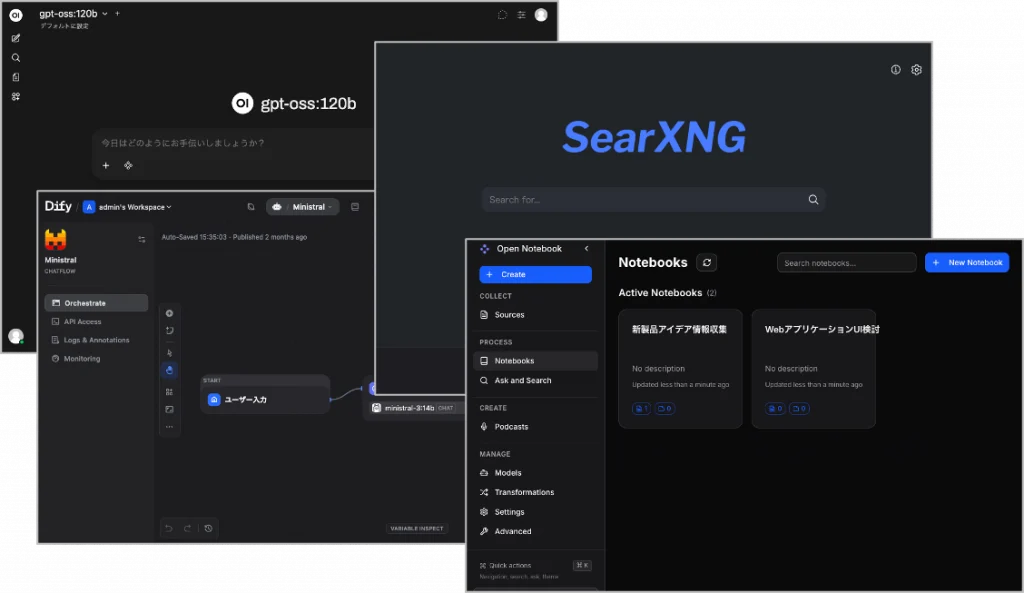

フェーズ1:OSSを活用した基盤構築と価値検証

OpenWebUI、SearXNG、Difyなどのオープンソースソフトウェア(OSS)を組み合わせ、以下の機能をローカル環境で構築します。

- インターネット検索と連携したAIチャット

- AIを活用した高度なワークフローの自動化

- セキュアな「ローカル版NotebookLM」環境の構築

フェーズ2:独自アプリケーションへのLLM組み込み

当社の事業推進本部を「仮想顧客」と見立て、実際の業務フローに即した「業務効率改善AIアプリケーション」の開発に挑戦します。現場のニーズに即したLLMの実装ノウハウを蓄積し、お客様へのソリューション提案に繋げます。

おわりに:次世代のAIインフラを、お客様の力に!

AIの進化スピードは驚異的ですが、その根幹を支えるのは「インフラ」と「データ処理」の確かな技術力です。

プログデンスは、NVIDIA DGX Sparkという強力な武器と、本プロジェクトを通じて得られた知見を駆使し、より安全で、より高度なAIソリューションを皆様に提供することを目指します。